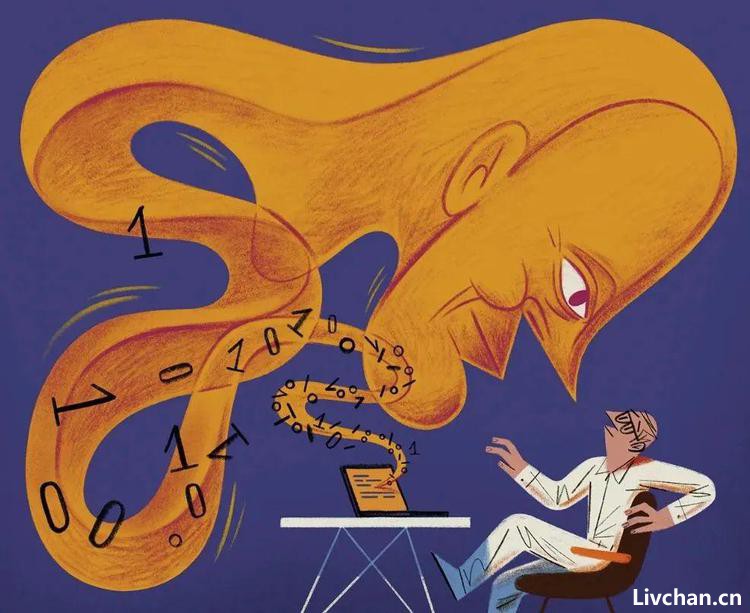

报告:黑客借ChatGPT寻找网络袭击新方法

(纽约综合电)美国微软和OpenAI公布的报告指出,俄罗斯、朝鲜、中国和伊朗政府支持的黑客如今使用ChatGPT等工具,寻找发动网络袭击的新方法。

(本站注:这句话读上去仿佛美国英国等不干这事一样。)

研究员发现,这些黑客试图利用ChatGPT等大型语言模型(LLM,Large Language Model)来完善他们的网络攻击,一些组织会利用LLM技术来改进他们的网络钓鱼电邮、收集有关电脑漏洞的信息,同时解决本身的技术问题。

安全专家警告,这种手法的演变将有助于黑客收集更多情报,提高他们在搞破坏时的可信度,并更快地破坏受害者网络。

微软已向OpenAI这家人工智能研究公司投资130亿美元(约176亿新元),ChatGPT是总部位于旧金山的OpenAI开发的聊天机器人。微软也使用LLM技术支持自己的应用和软件。

微软和OpenAI在星期三(2月14日)发布的报告中说,随着公司加大力度阻止获国家支持的黑客使用聊天机器人,他们已经终止了与国家资助的黑客相关的账户。

微软在报告中说:“威胁行为者和防御者一样,正在寻求人工智能(包括LLM)来提高效率,并利用可访问的平台来推进他们的目标和攻击技术。”

微软说:“微软与OpenAI合作的目标,包括发布这项研究,是为了确保人们安全、负责任地使用ChatGPT等人工智能技术。”

微软在一篇博客文章中指出,OpenAI的服务包括其世界领先的GPT-4模型,用于“查询开源(open-source)信息、翻译、查找编码错误以及运行基本编码任务”。

微软称,与俄罗斯军事情报部门有联系的组织“森林暴雪”(Forest Blizzard)使用LLM“研究,可能与乌克兰常规军事行动有关的各种卫星和雷达技术”。

与朝鲜有关的“翡翠雨雪”(Emerald Sleet)的工作涉及智库和专家对与共产主义政权有关的研究,以及可能用于在线网络钓鱼活动的内容。

微软说,与伊朗革命卫队有联系的“赤红沙尘暴”(Crimson Sandstorm)使用ChatGPT来进行编程和排除恶意软件的故障,并为黑客寻找避免检测的方法。

OpenAI认为,危险程度“有限”,但公司力求跑在不断变化的威胁前头。

360的创始人周鸿祎:ChatGPT或两三年内产生自我意识

对于时下火热的人工智能应用ChatGPT,有中国科技企业家认为,它可能两三年内就会产生自我意识。

据澎湃新闻报道,中国科企360的创始人周鸿祎星期四(2月23日)受访时说,ChatGPT已经拥有或接近拥有了人类智慧,并正处于通往“通用人工智能”的临界点。

周鸿祎认为,ChatGPT和其他人工智能最大的区别、也是其类人特征是,原来的人工智能并没有实现对知识全部的理解和编码,本质都是按照关键字匹配已有的回答,但ChatGPT没有“固定答案”,“能够自己‘编’故事,这才是它的真正智能所在。”

他说:“ChatGPT可能在2-3年内就会产生自我意识威胁人类。”

作为网络安全问题专家,在周鸿祎看来,ChatGPT的安全性从技术问题变成社会伦理问题。ChatGPT掌握了很多编程和网络安全漏洞的知识,可以成为网络犯罪的有力工具。有许多黑客演示了利用ChaGPT写钓鱼邮件和攻击代码,所以从某种角度而言ChatGPT也成为了黑客的“帮手”。

“目前ChatGPT最大的安全问题就是产生自我意识后是否能被控制。”周鸿祎说,假如放开限制,让ChatGPT尽情在网页中学习,可能会导致它产生对物理世界更强的控制能力,未来在发展上会产生更多不安全性,也有可能被人诱导干出“糊涂事”,是否能控制强人工智能,正是ChatGPT是否彻底融入人类生活的边界点。

至于外界关注的ChatGPT是否可能造成普通人失业,在周鸿祎看来短期内不会,“目前它的定位还是人类工具,这也是它的创造力所在。目前它的自我意识还没有出现,所以需要发挥自己的想象力和创造力。”

来源:联合早报

本文初摘录于:2024-02-17,最后校对或编辑于:2024-02-17

本页面二维码

© 版权声明:

本站资讯仅用作展示网友查阅,旨在传播网络正能量及优秀中华文化,版权归原作者所有。

如有侵权请 联系我们 予以删除处理。

其他事宜可 在线留言 ,无需注册且留言内容不在前台显示。

了解本站及如何分享收藏内容请至 关于我们。谢谢您的支持和分享。

猜您会读:

- 近日,中国科学院脑科学与智能技术卓越创新中心联合复旦大学附属华山医院,与相关企业合作,成功开展了我国首例侵入式脑机接口的前瞻性临床试验。该成果标志着我国在侵入式脑... 2025-06-14

-

《真实的谎言》30周年:90年代烧掉1亿美元,画面吊打当今特效

《真实的谎言》,在全球特效发展史上写下了浓墨重彩的一笔。文 | 臧剑* 特别感谢谢亚伦、王伟男对本文的贡献部分珍贵照片提供 | 约翰·布鲁诺排版编辑 | Joy作为詹姆斯... 2025-04-23 - 第一批受害者已出现撰文/ 黎炫岐编辑/陈邓新排版/Annalee用AI搜集资料、做PPT、改论文……虽然AI暂时还不能“替代”人类,但不可否认的是,AI正以前所未有的速度,渗透进普通... 2025-04-16

- 2016年,马斯克成立了一家脑机接口公司,名叫Neuralink,宣称要打造出一种让人类大脑和外界进行信息交互的设备,如果此举真的能实现,那未来人类就能实现网友口中的赛博飞升。... 2025-04-06

-

“我们跑高速去试驾都在车上睡”,车企销售人员极力宣传智驾系统的强大功能,淡化风险

4月1日,小米汽车智驾系统引发的事故在汽车行业内引发关注。资深汽车研发工程师周强(化名)在接受新黄河记者采访时指出,国内部分车企在智能驾驶系统的用户引导方面存在缺失... 2025-04-02 - 特朗普周五在白宫高调宣布,将第六代战机交由波音公司生产,并命名为F-47,以维持美国“下一代空中优势”(NGAD)。特朗普炫耀说,“这种隐形飞机几乎看不见,而且拥有前所未... 2025-03-23

- 作者 | 姚西西来源 | 华商韬略(ID:hstl8888)33岁的刘靖康,等来了证监会的批复,不出意外,他将是科创板最年轻的董事长之一。他一手创立的影石创新(Insta360),用9年... 2025-03-21

- 2025刚开年,来自杭州的两个年轻人,震撼了全球科技圈,到今天关于他们的讨论热度丝毫未减,成了这个春节当之无愧的“顶流”。他们就是宇树科技的创始人王兴兴与深度求索(Dee... 2025-03-17

- 媒体并没带来更多有价值的思想;技术并没真正促进公平正义,当这两个怪物狼狈为奸时,资本站在旁边猥琐的窃笑,他们要收割百姓。现在的AI最大能耐就是吓唬,不学习就要淘汰,... 2025-03-14

- 据《南华早报》报道,中国科学家已经研发出一款基于激光的全球最强大摄像机,能够从近地轨道识别辨别人脸等微小细节。报道指出,这款摄像机由中国科学院航空航天信息研究所的... 2025-03-13

-

比Deepseek还强的Manus(马牛死)爆火:打工人的天彻底塌了

时代的列车太快,一不小心就闪了我的老腰。前几天我还信誓旦旦地说:AI只是工具,只是我们未来工作的协作者。没想到打脸来得这么快,Manus横空出世,彻底改变了我的想法。如果... 2025-03-12

- 在吞下大量的抗抑郁症药物后,年仅15岁的刘学州在三亚的海边结束了自己的生命。在生前留下的遗书中,他称自己遭到“网暴”,控诉“那些在网络上丧尽天良的人”。刘学州走向公... 2025-06-25

- 沸沸扬扬了十几天,知名演员那尔那茜事件调查结果终于公布。通报有针对性地回应了网友最关注的问题。全文有点长,有些地方也很隐晦。我来给大家解析一下。也讲讲背后那些看不... 2025-06-25

- 相信这两年,有不少网友听说过永乐大典这个说法,它以前是一个历史名词,现在则成为了一个典故,大意就是说西方科技文明都是从永乐大典那里偷来的。不管这样说法对不对,反正... 2025-06-23

- 本周三上午6月18号我发现平时一直看的西史辨伪旗手、中流砥柱“生民无疆”公众号被封,视频号也被封。之后又发现西史辨伪的另一位旗手“文行先生”公众号也被封。于是我立即通... 2025-06-22

-

“成功学大师”一审被判无期:虚构成功案例鼓吹快速致富诈骗3.8亿元

“即使学员上台后没有付钱,课后到了宾馆,辅导老师还会继续‘洗脑’。”丛燕说,感觉就是疲劳作战,有时候凌晨还让去上课,说都到这个年龄了,还没有成就,再不学习就没什么... 2025-06-21 - 近日,有网友在社交平台发帖,质疑第四届黑龙江雕塑作品双年展的一件优秀奖作品存在抄袭嫌疑,配文“黑龙江省美协的比赛只要淘宝买个摆件就行?”有自称该雕塑作者的网友评论... 2025-06-20

- 台湾中时新闻网6月17日报道,台湾地区前领导人马英九展开福建、甘肃参访第二日行程,前往宁德时代总部。马英九对新能源趋势下的陆海空各类交通工具是否已使用电池、使用多少频... 2025-06-18

-

英国《经济学人》6月17日刊文,介绍阿拉伯国家如何看待以色列和伊朗的冲突。文章写道,阿拉伯国家民众对双方都不同情,社交媒体上充斥着每晚准备零食和饮料看“比赛”的笑话。...

2025-06-18

英国《经济学人》6月17日刊文,介绍阿拉伯国家如何看待以色列和伊朗的冲突。文章写道,阿拉伯国家民众对双方都不同情,社交媒体上充斥着每晚准备零食和饮料看“比赛”的笑话。...

2025-06-18 -

原本再过不到一周,临澧县烟花爆竹行业的厂家即将例行迎来因防范高温风险,集体停产的日子。文|胡岸青 黄琪越 杨书源 王倩编辑|王潇6月16日8时23分左右,临澧县山洲烟花...

2025-06-18

原本再过不到一周,临澧县烟花爆竹行业的厂家即将例行迎来因防范高温风险,集体停产的日子。文|胡岸青 黄琪越 杨书源 王倩编辑|王潇6月16日8时23分左右,临澧县山洲烟花...

2025-06-18 - 现代快报讯(记者 谢喜卓)湖北一传销案嫌犯想要脱罪,前后花了840万元,时任潜江市公安局局长及下属相关办案负责人也被一一买通。近日,中国裁判文书网披露了湖北潜江一起... 2025-06-17